新着記事

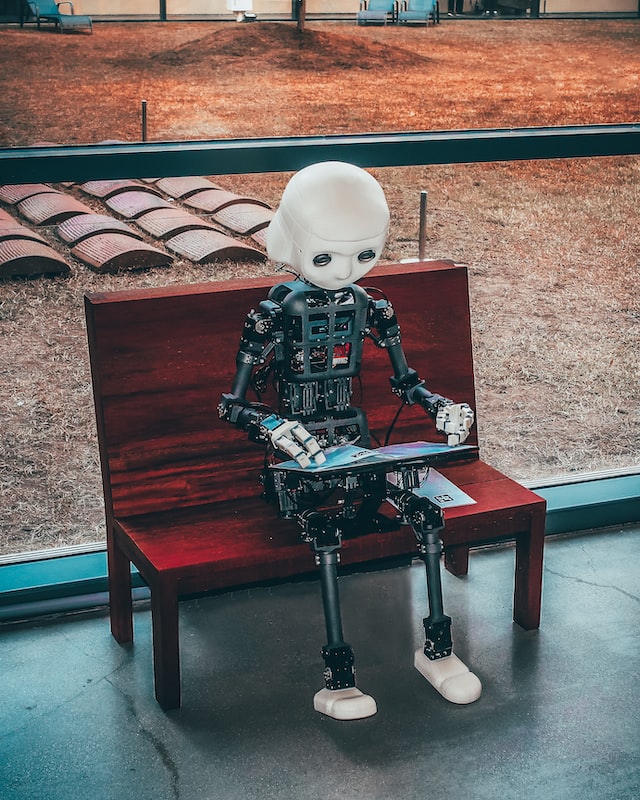

見極める力を養う「チャットボットの精度」

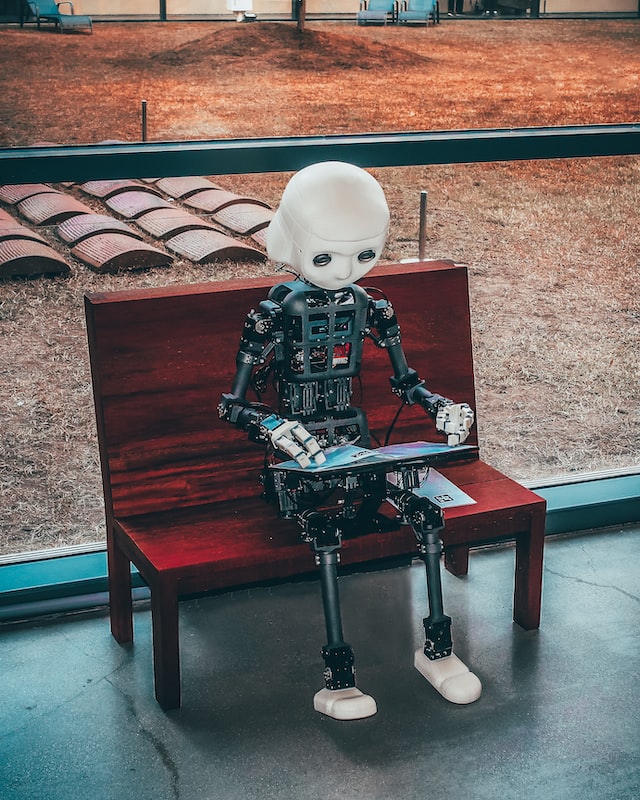

ChatGPTをはじめ、チャットボットの精度は人が書いたものかどうかわからない程までの水準になっています。

The most recent generation of chatbots has surfaced longstanding concerns about the growing sophistication and accessibility of artificial intelligence.

参照元:https://blog.seas.upenn.edu/real-or-fake-text-we-can-learn-to-spot-the-difference/

– ペンシルバニア大学工学部・応用科学部 University of Pennsylvania School of Engineering and Applied Science. February 27, 2023 –

最新世代のチャットボットは、人工知能の高度化とアクセシビリティの向上に関する長年の懸念を表面化させている。

創造経済から経営者層まで、雇用市場の完全性に関する懸念は、教育者がChatGPTをきっかけに学習を見直す中で、教室にも広がっている。

しかし、雇用や学校に関する懸念が見出しを飾っている一方で、ChatGPTのような大規模な言語モデルの影響は、私たちの生活のほぼ隅々にまで及んでいるというのが実情です。

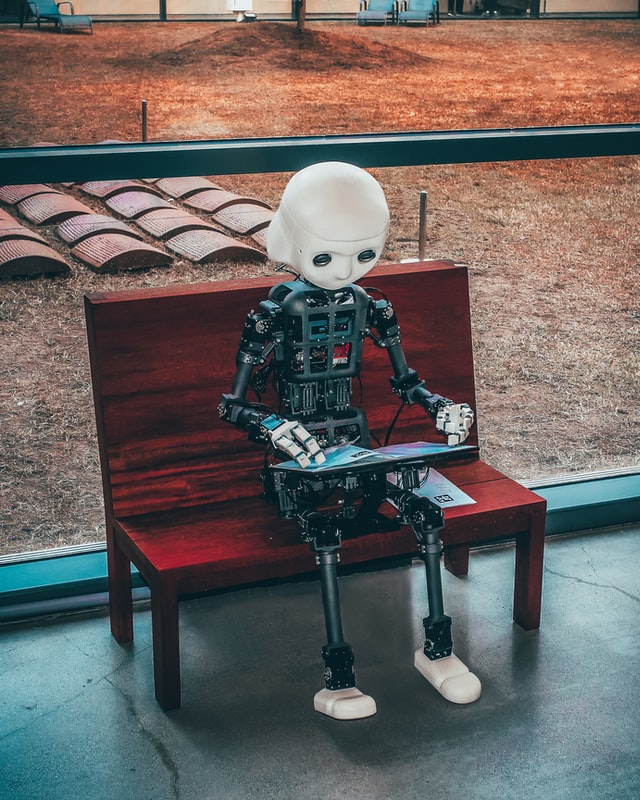

これらの新しいツールは、社会的偏見の強化、詐欺や個人情報窃盗、フェイクニュースの生成、誤った情報の拡散など、人工知能の役割について社会全体に懸念を抱かせるものです。

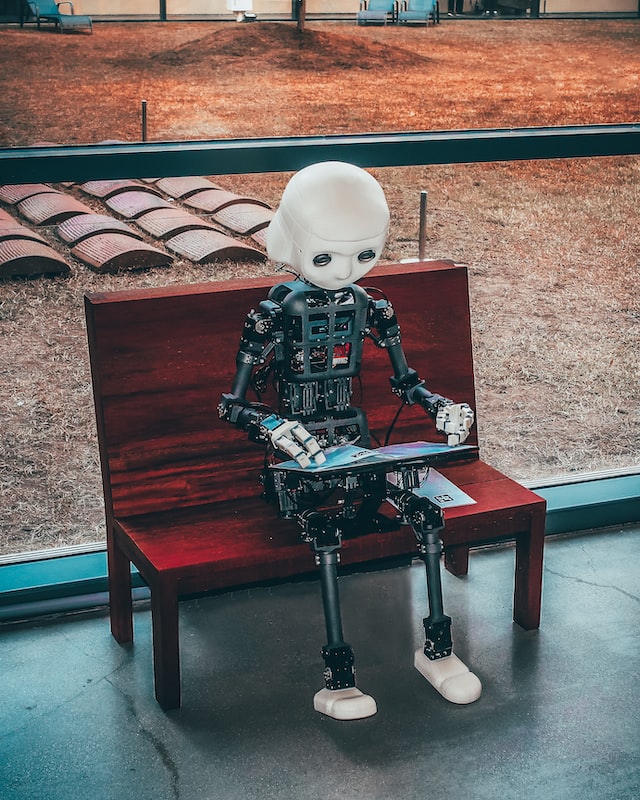

ペンシルバニア大学工学部応用科学科の研究チームは、これらのリスクを軽減するために、技術ユーザーの能力を高めようとしています。

人工知能学会(Association for the Advancement of Artificial Intelligence)の2023年2月の会合で発表された査読付き論文で、人は機械が生成したテキストと人が書いたテキストの違いを見分けることを学習できることを実証しています。

レシピを選んだり、記事を共有したり、クレジットカードの詳細を入力したりする前に、情報源の信頼性を見分けるための手順があることを知っておくことは重要です。

コンピュータ情報科学科(CIS)の准教授であるクリス・カリソン=バーチ氏が、CISの博士課程の学生であるリアム・ドゥーガン氏とダフネ・イポリト氏とともに主導したこの研究は、AIが生成したテキストが検出可能であるという証拠を示しています。

バーチ氏:我々は、人々が機械で生成されたテキストを認識するために自分自身を訓練することができることを示しました。機械がどのような誤りを犯すかについて、人はある種の仮定から始めますが、その仮定は必ずしも正しいとは限りません。十分な例と明確な指示があれば、時間をかけて、現在機械が犯しているエラーの種類を拾い上げることができるようになります。

ドゥーガン氏:今日のAIは、非常に流暢で、非常に文法的なテキストを生成することに驚くほど優れています。しかし、間違いも犯すのです。例えば、常識的なエラー、関連性のエラー、推論エラー、論理的エラーなど、機械が独特のタイプのエラーを起こすことを証明し、それを発見する方法を学ぶことができます。

この研究では、ウェブベースのオリジナルトレーニングゲーム「Real or Fake Text?」を使用して収集したデータを使用しています。

このトレーニングゲームは、検出研究の標準的な実験手法を、人々がAIを使ってテキストを生成する様子をより正確に再現するものに変えている点が注目されます。

標準的な方法では、参加者は与えられたテキストを機械が生成したかどうかをYESかNOで示すように要求されます。

このタスクは、単にテキストを本物か偽物かに分類するもので、回答は正解か不正解かで採点される。

ペンのモデルは、最初はすべて人間が書いた文章である例を示すことで、標準的な検出研究を効果的な訓練課題として大幅に改良したものである。

各例は、その後、生成されたテキストに移行し、この移行がどこから始まると思うかを被験者にマークしてもらう。

受講者は、誤りを示すテキストの特徴を特定し、それを記述してスコアを得ます。

その結果、受講者は偶然の一致を大きく上回るスコアを獲得し、AIが作成したテキストはある程度検出可能であることを証明することができました。

ドゥーガン氏:私たちの方法は、タスクをゲーム化してより魅力的にするだけでなく、より現実的なコンテキストをトレーニングに提供します。ChatGPTで生成されるようなテキストは、人間が提供するプロンプトから始まります。

この研究は、現在の人工知能についてだけでなく、この技術と私たちとの関係について、心強く、刺激的でさえある未来について概説しています。

ドゥーガン氏:5年前、モデルたちは話題から離れず、流暢な文章を書くことができませんでした。現在では、文法のミスはほとんどありません。私たちの研究は、AIチャットボットに特徴的なエラーを特定していますが、これらのエラーは進化しており、今後も進化し続けることを念頭に置いておくことが重要です。懸念すべきは、AIが書いた文章が検出できない、というシフトではありません。人々が違いを認識するための訓練を続け、補完的に検出ソフトウェアと連携する必要があるということです。

バーチ氏:人々がAIに不安を抱くのには正当な理由があります。私たちの研究は、こうした不安を和らげるための根拠となるポイントを示しています。AIテキストジェネレータに対する楽観的な見方を活かすことができれば、これらのツールが、より想像力に富んだ、より興味深い文章を書くことを助ける能力に注意を向けることができるようになるでしょう。

ペンシルバニア大学の研究の共同リーダーであり、現在GoogleのリサーチサイエンティストであるIppolitoは、Duganの検出への焦点を、これらのツールの最も効果的な使用例を探るという彼女の研究の重点で補完している。

例えば、彼女は、出版されている作家と共同で開発したAI創作ツール「Wordcraft」に貢献しています。

作家や研究者の誰も、AIが小説家の代わりとして説得力があるとは思わなかったが、創作プロセスをサポートする能力に大きな価値を見いだしたのだ。

バーチ氏:現時点での私の感覚では、これらのテクノロジーは創作活動に最も適していると思います。ニュースや論文、法律相談などは、事実関係が保証されないので、使えないケースです。

ドゥーガン氏:この技術には、刺激的で前向きな方向性がある」と言う。「人々は、盗作やフェイクニュースのような心配な例に固執していますが、私たちは、より良い読み手と書き手になるために自分自身を訓練することができることを知っているのです。

この記事が気に入ったら

いいね または フォローしてね!

関連記事

新着記事

-

男女ともに長生きになる「男女平等」2023.03.07健康

男女ともに長生きになる「男女平等」2023.03.07健康 -

他者を犠牲にして利益を取る・利益を度外視して他者への害を取り除く2023.03.06人体・脳

他者を犠牲にして利益を取る・利益を度外視して他者への害を取り除く2023.03.06人体・脳 -

「寿命を延ばす」良質な睡眠2023.03.05健康

「寿命を延ばす」良質な睡眠2023.03.05健康 -

見極める力を養う「チャットボットの精度」2023.03.04技術

見極める力を養う「チャットボットの精度」2023.03.04技術 -

健康増進と生きがいにつながる「森林浴」2023.03.03健康

健康増進と生きがいにつながる「森林浴」2023.03.03健康 -

米国の6人に1人「肥満による死」2023.03.02健康

米国の6人に1人「肥満による死」2023.03.02健康 -

週休4日制で生産を維持する2023.03.01社会

週休4日制で生産を維持する2023.03.01社会 -

オンライン学習で学生に届く教育方法2023.02.28学習

オンライン学習で学生に届く教育方法2023.02.28学習 -

学業成績に影響を与える「夜間の睡眠」2023.02.27健康

学業成績に影響を与える「夜間の睡眠」2023.02.27健康 -

心の豊かさに大きく影響を与える「目的意識を持った10代の若者」2023.02.26健康

心の豊かさに大きく影響を与える「目的意識を持った10代の若者」2023.02.26健康

よく読まれている記事

-

なぜタイピングより手書きの方が、記憶に定着するのか

なぜタイピングより手書きの方が、記憶に定着するのか -

どんな曲が好き?「 音楽の好みと性格の関連性は普遍的 」

どんな曲が好き?「 音楽の好みと性格の関連性は普遍的 」 -

視覚と意思決定領域の結びつきが強い「鮮明なイメージ能力がある人」

視覚と意思決定領域の結びつきが強い「鮮明なイメージ能力がある人」 -

「触覚が敏感な部位はなぜあるのか」触覚メカニズムが解明される

「触覚が敏感な部位はなぜあるのか」触覚メカニズムが解明される -

不活性化されたリチウムイオン電池を甦えさせる「復活するリチウムイオン電池」

不活性化されたリチウムイオン電池を甦えさせる「復活するリチウムイオン電池」 -

記憶が脳に保存される新しい理論「MeshCODE理論」が開発される

記憶が脳に保存される新しい理論「MeshCODE理論」が開発される -

大面積有機フォトダイオードに置き換わる?「シリコンフォトダイオード技術」

大面積有機フォトダイオードに置き換わる?「シリコンフォトダイオード技術」 -

幸福度を7%上げる「旅行の仕方」

幸福度を7%上げる「旅行の仕方」 -

「世界最長寿記録を更新し132歳まで生きる人が出現する」ベイズ統計学予測

「世界最長寿記録を更新し132歳まで生きる人が出現する」ベイズ統計学予測 -

組織の中で行われたインシビリティ(非礼な言動)を軽視してはいけない理由

組織の中で行われたインシビリティ(非礼な言動)を軽視してはいけない理由

N E W S & P O P U L A R最 新 記 事 & 人 気 記 事

WHAT'S NEW !!

-

男女ともに長生きになる「男女平等」

【男女ともに長生きになる「男女平等」】 権利とは人間が作り出した構造ですが、男女平等が進むと男女ともに長生きになるようです。 The first global study to investi... -

他者を犠牲にして利益を取る・利益を度外視して他者への害を取り除く

【他者を犠牲にして利益を取る・利益を度外視して他者への害を取り除く】 他者を犠牲にして自分の利益を選ぶ、自分にとって利益は少ないが他者への害を防ぐ、道徳的なに... -

「寿命を延ばす」良質な睡眠

【「寿命を延ばす」良質な睡眠】 良質な睡眠をとることは、寿命を何年も長くする可能性があります。 Getting good sleep can play a role in supporting your heart and... -

見極める力を養う「チャットボットの精度」

【見極める力を養う「チャットボットの精度」】 ChatGPTをはじめ、チャットボットの精度は人が書いたものかどうかわからない程までの水準になっています。 The most rec...

-

なぜタイピングより手書きの方が、記憶に定着するのか

【なぜタイピングより手書きの方が、記憶に定着するのか】 ノルウェー科学技術大学の研究によると、手書きの方が物事をよく覚えることが判明しました。 様々なコンピュ... -

どんな曲が好き?「 音楽の好みと性格の関連性は普遍的 」

【どんな曲が好き?「 音楽の好みと性格の関連性は普遍的 」】 激しい音楽を好んで聴く人は、激しい性格の持ち主なのでしょうか?研究者は、音楽の好みと性格の関連性は... -

視覚と意思決定領域の結びつきが強い「鮮明なイメージ能力がある人」

【視覚と意思決定領域の結びつきが強い「鮮明なイメージ能力がある人」】 鮮明にイメージできる人は、視覚ネットワークと意思決定に関連する脳の領域が強く結びついてい...

News

- 新着記事 -

Popular

- 人気記事 -

H A P P I N E S S幸 福

人気 (❁´ω`❁)

M E A L食 事

B R A I N脳

人気 (❁´ω`❁)

H E A L T H健 康

人気 (❁´ω`❁)

-

人体・脳

健康な脳を保ち老化を遅らせる「アマゾンの先住民族ツィマネ族の生活習慣」

【健康な脳を保ち老化を遅らせる「アマゾンの先住民族ツィマネ族の生活習慣」】 ボリビア・アマゾンの先住民族であるツィマネ族が、アメリカやヨーロッパの人々に比べて... -

社会

自制心が健康と若さをもたらす理由

【自制心が健康と若さをもたらす理由】 デューク大学の研究チームは、自制心が心身に及ぼす影響を調査しました。 1000人を出生から45年間に渡って追跡した大規模調査で... -

健康

高強度インターバルトレーニングは、適度な運動よりも心臓を強化する

【心臓を強化する高強度インターバルトレーニング】 ノルウェー科学技術大学の研究によると、トレーニングの強度が、病気の重症度を軽減し、心臓機能を改善し、作業能力...

-

人体・脳

健康な脳を保ち老化を遅らせる「アマゾンの先住民族ツィマネ族の生活習慣」

【健康な脳を保ち老化を遅らせる「アマゾンの先住民族ツィマネ族の生活習慣」】 ボリビア・アマゾンの先住民族であるツィマネ族が、アメリカやヨーロッパの人々に比べて... -

社会

自制心が健康と若さをもたらす理由

【自制心が健康と若さをもたらす理由】 デューク大学の研究チームは、自制心が心身に及ぼす影響を調査しました。 1000人を出生から45年間に渡って追跡した大規模調査で... -

健康

高強度インターバルトレーニングは、適度な運動よりも心臓を強化する

【心臓を強化する高強度インターバルトレーニング】 ノルウェー科学技術大学の研究によると、トレーニングの強度が、病気の重症度を軽減し、心臓機能を改善し、作業能力...

J O B仕 事

人気 (❁´ω`❁)

-

社会

週休4日制で生産を維持する

-

人体・脳

アイデアや閃きが降りてくる「横断的なコミュニケーション」

-

社会

大災害を読み解く鋭い解決策

-

思考・瞑想

賞や表彰が発明家の創造性を低下させる

-

人体・脳

創造的な人はここが違う!「非創造的なハブを回避し非典型的なアプローチをする」

-

社会

アメリカ陸軍で既に多数の成功を収めている「人々を創造的にするトレーニング」

-

社会

2年は普及しない?「カテゴリーイノベーション戦略」

-

社会

管理者級以上必見「創造性を引き出す同僚間の友情とサポートを育む組織づくり」

-

社会

アイデアを創出する人数「少人数のグループのほうが新しいアイデアが出やすい」

-

健康

散った気を元の集中に戻す「1日最大50%費やす迷いを断つマインドフルネス」

-

社会

移動によるエネルギーが激減「環境に優しく誰でも参加できるオンライン会議」

-

社会

山火事コスト数十億ドルのコスト削減「インドネシアの泥炭地回復」

-

社会

価格末「99円」設定が販売者に不利益を及ぼす驚愕の理由

-

社会

購買意欲を掻き立てる商品提示方法

-

社会

「感情的異質性」がチームの創造性を高める

-

社会

従業員の創造性を高める驚愕の方法「報酬を選択制にする」

-

社会

テクノロジーの力でセレンディピティを生み出す

-

社会

様々なテーマの問題への取り組みにつながる「ダ・ヴィンチ構想」

-

社会

改善が必要な状況に「やめる」という解決策がでない理由

-

社会

空想が苦手な理由と、その修正方法

-

学習

パズル解きの極意、最良の選択より優れた驚愕の方法

-

社会

大麻が独創的で実現不可能なアイデアを創出するという実験結果

-

社会

記憶に残るユーモアを含んだニュース

-

社会

なぜメッセージと画像が一致してない情報は伝わらないのか

-

社会

消費者を購買に結びつける音楽

-

技術

自動化工場などの緊急事態に備えて知識を生かしておく方法

-

社会

「生産性も顧客満足度も向上」プロジェクトに自主性を持たせる

-

人体・脳

人は1日に35,000回の意思決定をしている「意思決定を行うアルゴリズム」

-

社会

他文化と頻繁衝突する文化圏は協力的なゲームが流行?「ゲームからみる文化」

-

社会

「通勤はわるいもの?」モバイルセンシングで仕事の成果と通勤の関連性を解明

-

社会

テクノロジーは労働者の幸福度にどのような影響を及ぼすか

-

社会

雇用の創出ではなく雇用の置換が進む「ロボットなどの作業の自動化」

-

社会

「柔軟で弾力性のある対応が可能」生物系を模倣した多様なサプライチェーン

-

社会

「患者のメンタルヘルスケアを向上させる」患者と心理療法士のマッチング

-

学習

デジタルデバイス用に最適なフォント「AdaptiFont」

T E C H N O L O G Y技 術

人気 (❁´ω`❁)