新着記事

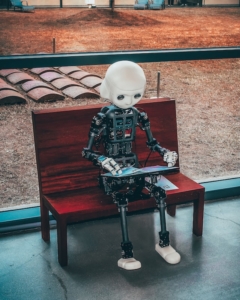

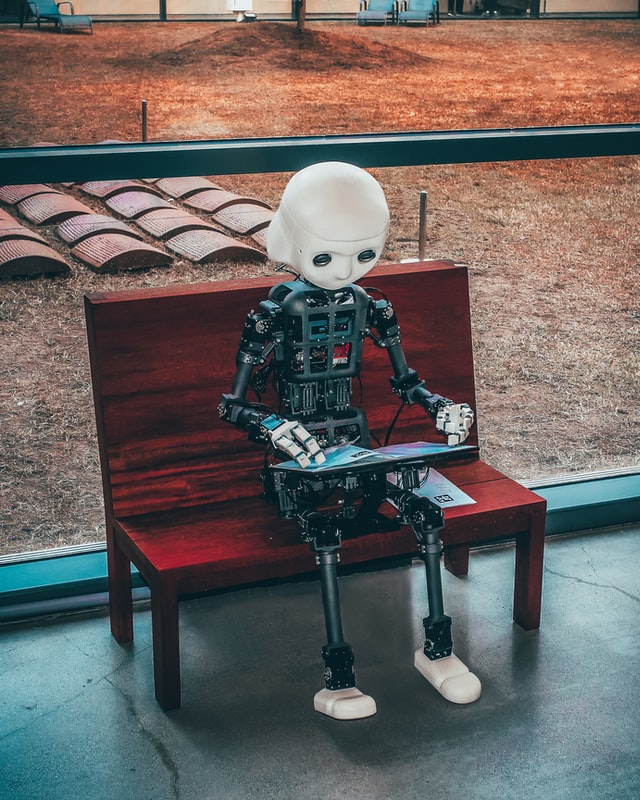

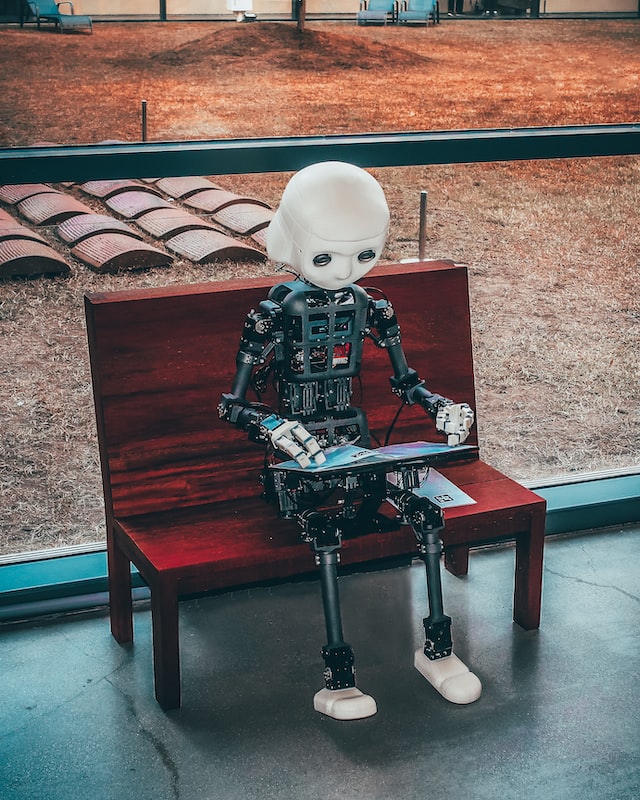

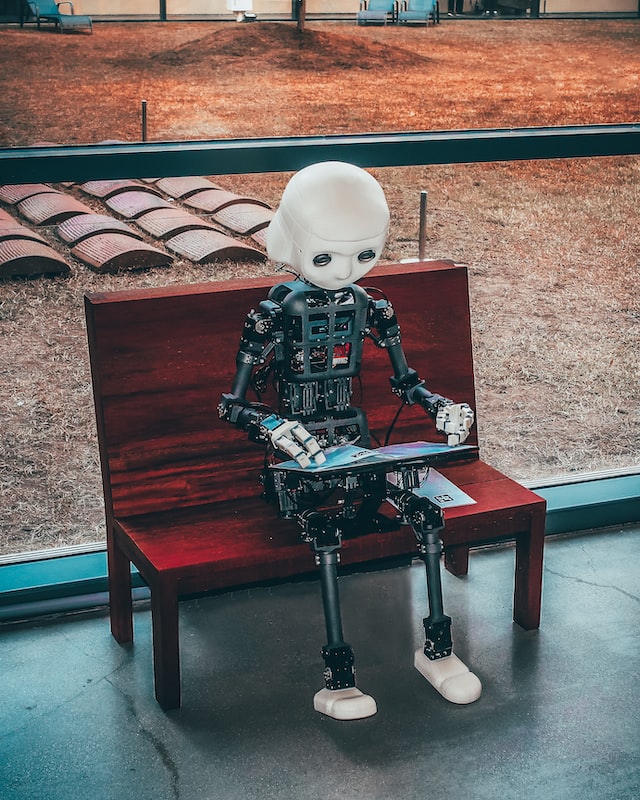

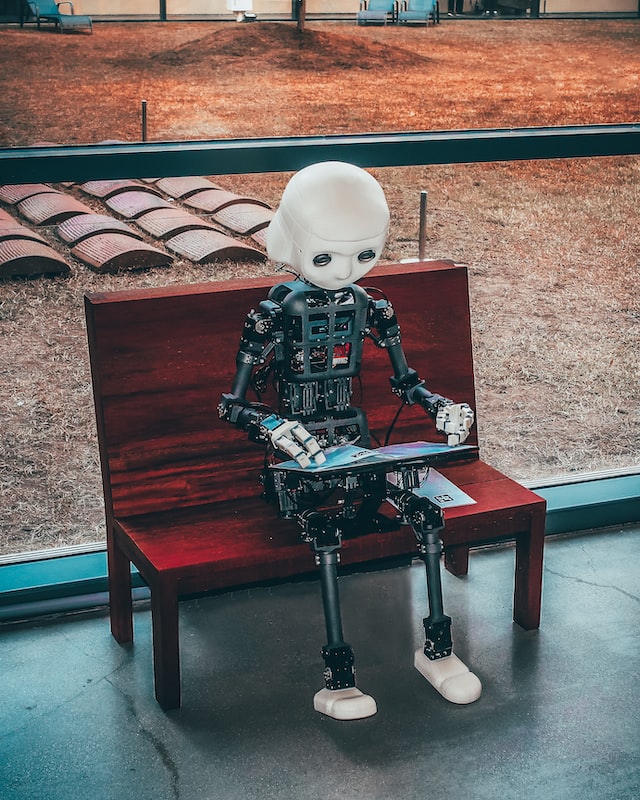

98%の精度で他者に共感するロボット

コロンビア大学がロボットのパートナーとの協力について実験解析しました。

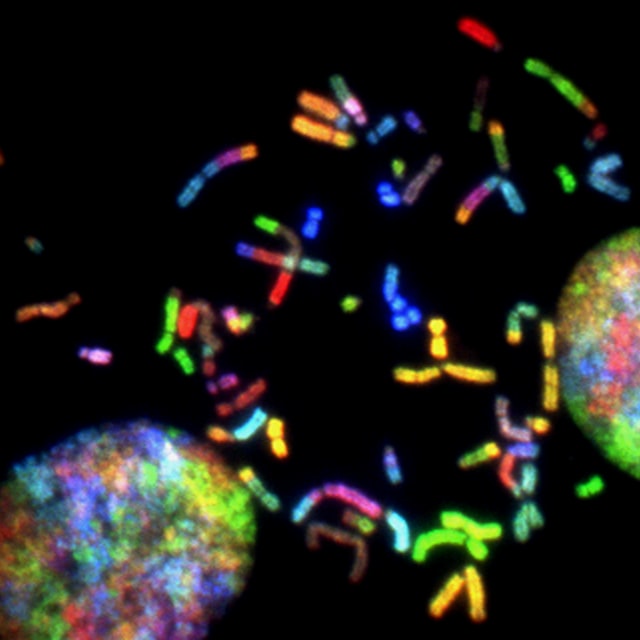

実験対象のロボットは、視覚を遮っていたパートナーロボットの情報を与えられず、さまざまな状況でパートナーロボットの目標と経路を100回のうち98回予測し、共感を示しました。

When two primates are cooped up together for a long time, we quickly learn to predict the near-term actions of our roommates, co-workers or family members. Our ability to anticipate the actions of others makes it easier for us to successfully live and work together. In contrast, even the most intelligent and advanced robots have remained notoriously inept at this sort of social communication. This may be about to change.

参照元:https://www.engineering.columbia.edu/press-release/lipson-robot-displays-empathy

– コロンビア大学 Columbia University. JAN 11 2021 –

お互いのあらゆる動きを予測できる長年のカップルのように、Columbia Engineeringロボットは、ほんの数個の初期ビデオフレームに基づいて、パートナーロボットの将来の行動と目標を予測することを学びました。

2匹の霊長類が長い間一緒に協力しているとき、私たちはすぐにルームメイト、同僚、または家族の短期的な行動を予測することを学びます。

他人の行動を予測する私たちの能力は、私たちがうまく生き、一緒に働くことを容易にします。

対照的に、最もインテリジェントで高度なロボットでさえ、この種の社会的コミュニケーションでは悪名高いほど無能なままです。

これはもうすぐ変わるかもしれません。

機械工学のホッド・リプソン教授が率いるコロンビアエンジニアリングのクリエイティブマシーンズラボで実施されたこの研究は、純粋に視覚的な観察から、他のロボットの目標を理解して予測する能力をロボットに与えるための幅広い取り組みの一環です。

研究者たちは最初にロボットを作り、それをおよそ3×2フィートの大きさのベビーサークルに置きました。

彼らは、ロボットが見える緑色の円を探してそれに向かって移動するようにロボットをプログラムしました。

しかし、落とし穴がありました。

ロボットがカメラの緑色の円を見て、それに向かって直接移動することがありました。

しかし、緑の円が背の高い赤いカーボードボックスによって遮られることもあります。

その場合、ロボットは別の緑の円に向かって移動するか、まったく移動しません。

パートナーのパタリングを2時間観察した後、観察ロボットはパートナーの目標と経路を予測し始めました。

観測ロボットは、パートナーの視界障害について明確に知らされることなく、さまざまな状況で、最終的にパートナーの目標と経路を100回のうち98回予測することができました。

コンピューターサイエンスの助教授であるCarl Vondrick氏と共同で実施され、Nature ScientificReportsによって公開された研究の筆頭著者であるBoyuanChen氏は話します。

「私たちの最初の結果は非常にエキサイティングです。私たちの調査結果は、ロボットが別のロボットの視点から世界をどのように見ることができるかを示し始めています。観察者がパートナーの立場になって、いわば、ガイドなしで、パートナーが見ることができるかどうかを理解する能力。見晴らしの良い場所から見た緑色の円は、おそらく原始的な形の共感です。」

Excited to present Eva, a robot face with soft skin that can mimic diverse facial expressions from humans!

— Boyuan Chen (@Boyuan__Chen) May 27, 2021

Overview video: https://t.co/GZtK7t0FP4

Project website: https://t.co/acgmVX3aDe

Paper to appear at #icra2021: https://t.co/UekPvvplkp (1/n) pic.twitter.com/YvHmXzv4rR

彼らが実験を設計したとき、研究者たちはオブザーバーロボットがサブジェクトロボットの短期的な行動について予測することを学ぶだろうと期待していました。

しかし、研究者が予想していなかったのは、オブザーバーロボットが、ほんの数秒のビデオを手がかりとして、同僚の将来の「動き」をどれほど正確に予測できるかということでした。

研究者たちは、この研究でロボットが示した行動は、人間の行動や目標よりもはるかに単純であることを認めています。

しかし、彼らは、これが認知科学者が「心の理論」(ToM)と呼ぶものをロボットに与えることの始まりかもしれないと信じています。

3歳くらいになると、子供たちは他の人が自分とは異なる目標、ニーズ、視点を持っている可能性があることを理解し始めます。

これは、隠れたり探したりするような遊び心のある活動や、嘘をつくなどのより洗練された操作につながる可能性があります。

より広くは、ToMは、人間と霊長類の認知の重要な特徴であり、協力、競争、共感、欺瞞などの複雑で適応性のある社会的相互作用に不可欠な要素として認識されています。

さらに、人間は、言語を使用して予測を記述する点で、ロボットよりも優れています。

研究者たちは、人間の言語の厄介な課題に巻き込まれるのを避けるために、観察ロボットに言葉ではなく画像の形で予測を行わせました。

リプソン氏は、ロボットが将来の行動を視覚的に予測する能力は独特ではないと推測しています。

リプソン氏は話します。

「私たち人間も視覚的に考えることがあります。言葉ではなく、心の目で未来を想像することがよくあります。」

リプソン氏は、多くの倫理的問題があることを認めています。

この技術はロボットの弾力性と有用性を高めますが、ロボットが人間の思考を予測できる場合、ロボットはそれらの思考を操作することも学ぶことができます。

リプソン氏は話します。

「私たちは、ロボットが受動的な命令追跡マシンであり続けることはないだろうと認識しています。他の形式の高度なAIと同様に、政策立案者がこの種のテクノロジーを抑制し、私たち全員が利益を得ることができるようになることを願っています。」

この記事が気に入ったら

いいね または フォローしてね!

関連記事

新着記事

-

男女ともに長生きになる「男女平等」2023.03.07健康

男女ともに長生きになる「男女平等」2023.03.07健康 -

他者を犠牲にして利益を取る・利益を度外視して他者への害を取り除く2023.03.06人体・脳

他者を犠牲にして利益を取る・利益を度外視して他者への害を取り除く2023.03.06人体・脳 -

「寿命を延ばす」良質な睡眠2023.03.05健康

「寿命を延ばす」良質な睡眠2023.03.05健康 -

見極める力を養う「チャットボットの精度」2023.03.04技術

見極める力を養う「チャットボットの精度」2023.03.04技術 -

健康増進と生きがいにつながる「森林浴」2023.03.03健康

健康増進と生きがいにつながる「森林浴」2023.03.03健康 -

米国の6人に1人「肥満による死」2023.03.02健康

米国の6人に1人「肥満による死」2023.03.02健康 -

週休4日制で生産を維持する2023.03.01社会

週休4日制で生産を維持する2023.03.01社会 -

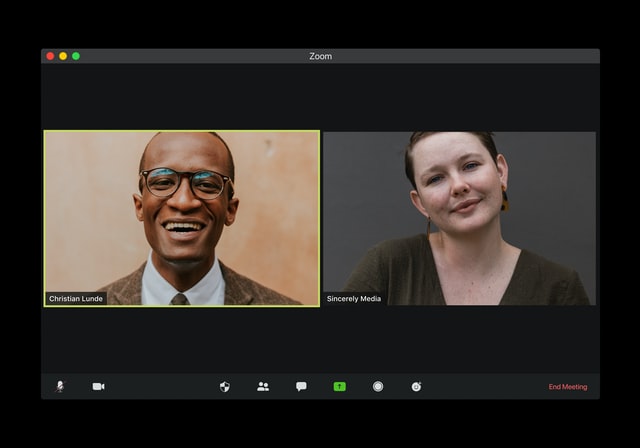

オンライン学習で学生に届く教育方法2023.02.28学習

オンライン学習で学生に届く教育方法2023.02.28学習 -

学業成績に影響を与える「夜間の睡眠」2023.02.27健康

学業成績に影響を与える「夜間の睡眠」2023.02.27健康 -

心の豊かさに大きく影響を与える「目的意識を持った10代の若者」2023.02.26健康

心の豊かさに大きく影響を与える「目的意識を持った10代の若者」2023.02.26健康

よく読まれている記事

-

なぜタイピングより手書きの方が、記憶に定着するのか

なぜタイピングより手書きの方が、記憶に定着するのか -

どんな曲が好き?「 音楽の好みと性格の関連性は普遍的 」

どんな曲が好き?「 音楽の好みと性格の関連性は普遍的 」 -

視覚と意思決定領域の結びつきが強い「鮮明なイメージ能力がある人」

視覚と意思決定領域の結びつきが強い「鮮明なイメージ能力がある人」 -

「触覚が敏感な部位はなぜあるのか」触覚メカニズムが解明される

「触覚が敏感な部位はなぜあるのか」触覚メカニズムが解明される -

不活性化されたリチウムイオン電池を甦えさせる「復活するリチウムイオン電池」

不活性化されたリチウムイオン電池を甦えさせる「復活するリチウムイオン電池」 -

記憶が脳に保存される新しい理論「MeshCODE理論」が開発される

記憶が脳に保存される新しい理論「MeshCODE理論」が開発される -

大面積有機フォトダイオードに置き換わる?「シリコンフォトダイオード技術」

大面積有機フォトダイオードに置き換わる?「シリコンフォトダイオード技術」 -

幸福度を7%上げる「旅行の仕方」

幸福度を7%上げる「旅行の仕方」 -

「世界最長寿記録を更新し132歳まで生きる人が出現する」ベイズ統計学予測

「世界最長寿記録を更新し132歳まで生きる人が出現する」ベイズ統計学予測 -

組織の中で行われたインシビリティ(非礼な言動)を軽視してはいけない理由

組織の中で行われたインシビリティ(非礼な言動)を軽視してはいけない理由

N E W S & P O P U L A R最 新 記 事 & 人 気 記 事

WHAT'S NEW !!

-

男女ともに長生きになる「男女平等」

【男女ともに長生きになる「男女平等」】 権利とは人間が作り出した構造ですが、男女平等が進むと男女ともに長生きになるようです。 The first global study to investi... -

他者を犠牲にして利益を取る・利益を度外視して他者への害を取り除く

【他者を犠牲にして利益を取る・利益を度外視して他者への害を取り除く】 他者を犠牲にして自分の利益を選ぶ、自分にとって利益は少ないが他者への害を防ぐ、道徳的なに... -

「寿命を延ばす」良質な睡眠

【「寿命を延ばす」良質な睡眠】 良質な睡眠をとることは、寿命を何年も長くする可能性があります。 Getting good sleep can play a role in supporting your heart and... -

見極める力を養う「チャットボットの精度」

【見極める力を養う「チャットボットの精度」】 ChatGPTをはじめ、チャットボットの精度は人が書いたものかどうかわからない程までの水準になっています。 The most rec...

-

なぜタイピングより手書きの方が、記憶に定着するのか

【なぜタイピングより手書きの方が、記憶に定着するのか】 ノルウェー科学技術大学の研究によると、手書きの方が物事をよく覚えることが判明しました。 様々なコンピュ... -

どんな曲が好き?「 音楽の好みと性格の関連性は普遍的 」

【どんな曲が好き?「 音楽の好みと性格の関連性は普遍的 」】 激しい音楽を好んで聴く人は、激しい性格の持ち主なのでしょうか?研究者は、音楽の好みと性格の関連性は... -

視覚と意思決定領域の結びつきが強い「鮮明なイメージ能力がある人」

【視覚と意思決定領域の結びつきが強い「鮮明なイメージ能力がある人」】 鮮明にイメージできる人は、視覚ネットワークと意思決定に関連する脳の領域が強く結びついてい...

News

- 新着記事 -

Popular

- 人気記事 -

H A P P I N E S S幸 福

人気 (❁´ω`❁)

M E A L食 事

B R A I N脳

人気 (❁´ω`❁)

H E A L T H健 康

人気 (❁´ω`❁)

-

人体・脳

健康な脳を保ち老化を遅らせる「アマゾンの先住民族ツィマネ族の生活習慣」

【健康な脳を保ち老化を遅らせる「アマゾンの先住民族ツィマネ族の生活習慣」】 ボリビア・アマゾンの先住民族であるツィマネ族が、アメリカやヨーロッパの人々に比べて... -

社会

自制心が健康と若さをもたらす理由

【自制心が健康と若さをもたらす理由】 デューク大学の研究チームは、自制心が心身に及ぼす影響を調査しました。 1000人を出生から45年間に渡って追跡した大規模調査で... -

健康

高強度インターバルトレーニングは、適度な運動よりも心臓を強化する

【心臓を強化する高強度インターバルトレーニング】 ノルウェー科学技術大学の研究によると、トレーニングの強度が、病気の重症度を軽減し、心臓機能を改善し、作業能力...

-

人体・脳

健康な脳を保ち老化を遅らせる「アマゾンの先住民族ツィマネ族の生活習慣」

【健康な脳を保ち老化を遅らせる「アマゾンの先住民族ツィマネ族の生活習慣」】 ボリビア・アマゾンの先住民族であるツィマネ族が、アメリカやヨーロッパの人々に比べて... -

社会

自制心が健康と若さをもたらす理由

【自制心が健康と若さをもたらす理由】 デューク大学の研究チームは、自制心が心身に及ぼす影響を調査しました。 1000人を出生から45年間に渡って追跡した大規模調査で... -

健康

高強度インターバルトレーニングは、適度な運動よりも心臓を強化する

【心臓を強化する高強度インターバルトレーニング】 ノルウェー科学技術大学の研究によると、トレーニングの強度が、病気の重症度を軽減し、心臓機能を改善し、作業能力...

J O B仕 事

人気 (❁´ω`❁)

-

社会

週休4日制で生産を維持する

-

人体・脳

アイデアや閃きが降りてくる「横断的なコミュニケーション」

-

社会

大災害を読み解く鋭い解決策

-

思考・瞑想

賞や表彰が発明家の創造性を低下させる

-

人体・脳

創造的な人はここが違う!「非創造的なハブを回避し非典型的なアプローチをする」

-

社会

アメリカ陸軍で既に多数の成功を収めている「人々を創造的にするトレーニング」

-

社会

2年は普及しない?「カテゴリーイノベーション戦略」

-

社会

管理者級以上必見「創造性を引き出す同僚間の友情とサポートを育む組織づくり」

-

社会

アイデアを創出する人数「少人数のグループのほうが新しいアイデアが出やすい」

-

健康

散った気を元の集中に戻す「1日最大50%費やす迷いを断つマインドフルネス」

-

社会

移動によるエネルギーが激減「環境に優しく誰でも参加できるオンライン会議」

-

社会

山火事コスト数十億ドルのコスト削減「インドネシアの泥炭地回復」

-

社会

価格末「99円」設定が販売者に不利益を及ぼす驚愕の理由

-

社会

購買意欲を掻き立てる商品提示方法

-

社会

「感情的異質性」がチームの創造性を高める

-

社会

従業員の創造性を高める驚愕の方法「報酬を選択制にする」

-

社会

テクノロジーの力でセレンディピティを生み出す

-

社会

様々なテーマの問題への取り組みにつながる「ダ・ヴィンチ構想」

-

社会

改善が必要な状況に「やめる」という解決策がでない理由

-

社会

空想が苦手な理由と、その修正方法

-

学習

パズル解きの極意、最良の選択より優れた驚愕の方法

-

社会

大麻が独創的で実現不可能なアイデアを創出するという実験結果

-

社会

記憶に残るユーモアを含んだニュース

-

社会

なぜメッセージと画像が一致してない情報は伝わらないのか

-

社会

消費者を購買に結びつける音楽

-

技術

自動化工場などの緊急事態に備えて知識を生かしておく方法

-

社会

「生産性も顧客満足度も向上」プロジェクトに自主性を持たせる

-

人体・脳

人は1日に35,000回の意思決定をしている「意思決定を行うアルゴリズム」

-

社会

他文化と頻繁衝突する文化圏は協力的なゲームが流行?「ゲームからみる文化」

-

社会

「通勤はわるいもの?」モバイルセンシングで仕事の成果と通勤の関連性を解明

-

社会

テクノロジーは労働者の幸福度にどのような影響を及ぼすか

-

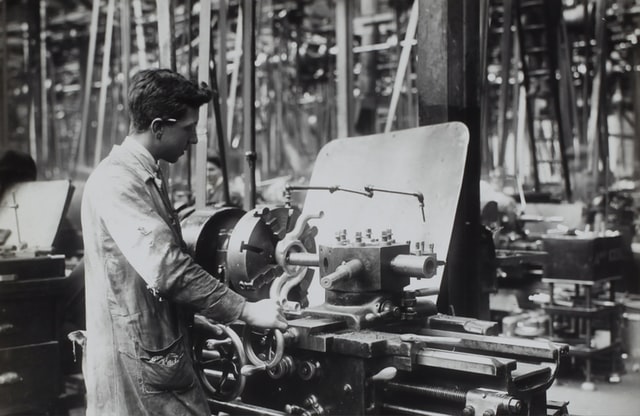

社会

雇用の創出ではなく雇用の置換が進む「ロボットなどの作業の自動化」

-

社会

「柔軟で弾力性のある対応が可能」生物系を模倣した多様なサプライチェーン

-

社会

「患者のメンタルヘルスケアを向上させる」患者と心理療法士のマッチング

-

学習

デジタルデバイス用に最適なフォント「AdaptiFont」

T E C H N O L O G Y技 術

人気 (❁´ω`❁)